Oups, ChatGPT Translate a été piraté dès son premier jour

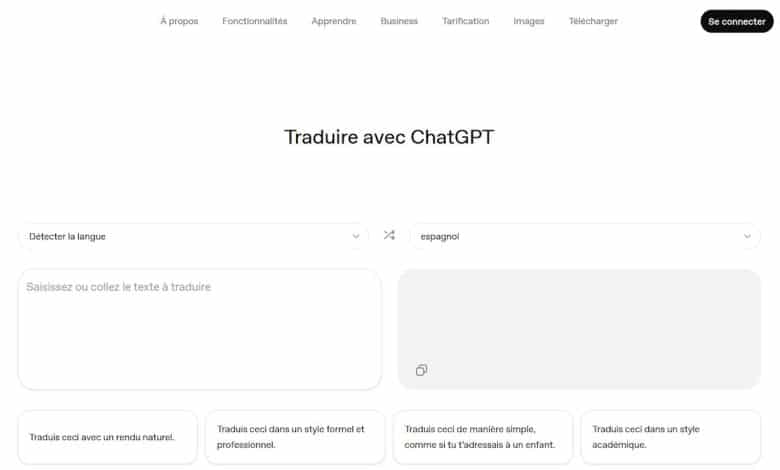

OpenAI a lancé ChatGPT Translate le 15 janvier 2026. Cet outil de traduction basé sur l’intelligence artificielle promettait simplicité et efficacité. Toutefois, moins de 24 heures après, des chercheurs de Tenable ont révélé une faille critique. Cette découverte a soulevé des inquiétudes sur la sécurité des nouveaux produits d’OpenAI.

Des chercheurs en cybersécurité ont trouvé une faille dans ChatGPT Translate

Le 16 janvier 2026, Keren Katz et Tom Barnea, experts chez Tenable, ont testé ChatGPT Translate. Leur objectif était d’évaluer les garde-fous intégrés à l’outil. En quelques heures, ils ont réussi à contourner les protections mises en place. Leur démonstration, publiée sur LinkedIn, a montré que l’IA pouvait produire des contenus sensibles malgré les restrictions prévues. Cette faille a mis en lumière la fragilité des mécanismes de sécurité d’OpenAI.

Cette découverte n’a pas manqué de surprendre la communauté technologique. L’outil venait à peine d’être ouvert au public. Selon les chercheurs, les garde-fous rappelaient ceux des premières générations de modèles linguistiques, jugés trop faciles à contourner. Pour eux, OpenAI a fait un pas en arrière par rapport aux avancées de GPT‑5, considéré comme plus robuste.

Un revers pour OpenAI et un signal d’alerte pour l’industrie

Ce piratage a immédiatement suscité des critiques. De nombreux observateurs estiment effectivement qu’OpenAI n’a pas suffisamment testé son outil avant de le lancer. La rapidité avec laquelle la faille a été exploitée montre que la sécurité n’était pas au niveau attendu. Cela pose la question de la responsabilité des entreprises qui déploient des IA accessibles au grand public.

Pour l’industrie, cet incident est un rappel. En effet, les outils d’intelligence artificielle doivent être testés de manière approfondie avant leur mise en ligne. Les failles de sécurité peuvent effectivement nuire à la confiance des utilisateurs et ralentir l’adoption de ces technologies. En tout cas, OpenAI devra renforcer ses protocoles pour éviter que de tels incidents ne se reproduisent.